Cuando, en el marco de las tertulias que con periodicidad bimensual organiza la Asociación Tertulia en Barbecho decidimos programar una bajo el título “La Inteligencia Artificial: ¿estamos ante un cambio de era?” me vino a la memoria el debate que se mantiene actualmente sobre la gobernanza de esta tecnología multidisciplinar con el objetivo de lograr que su utilización responda a principios éticos, de justicia, equidad, seguridad y responsabilidad.

Entre ellos he elegido los éticos como tema para este artículo considerando su importancia pues, ante la posibilidad de que las máquinas puedan convertirse en entes con su propia moral, es indispensable lograr el equilibrio entre ética y tecnología de modo que se garantice el respeto a nuestros principios y valores.

Inteligencia Artificial; una disciplina por definir

Antes de llevar a cabo una revisión sobre algunas iniciativas que se están presentando en este domino considero conveniente hacer una breve introducción al sujeto objeto del análisis; la Inteligencia Artificial

Desde sus orígenes en los años 50, donde destacan las figuras de Alan Turing, quien formulaba la pregunta de si una máquina puede pensar, y John McCarthy, el primero que utilizo el término, su evolución ha estado marcada por la permanente ausencia de consenso en su definición, lo cual da lugar a interpretaciones erróneas sobre el concepto.

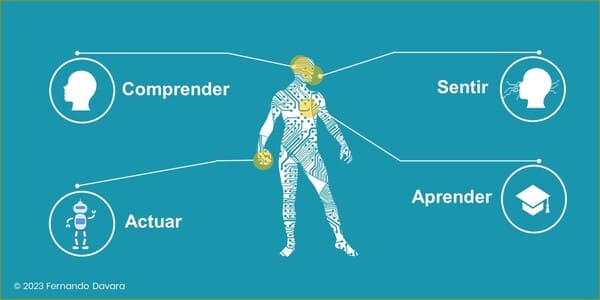

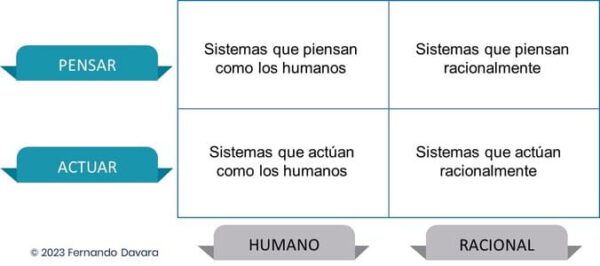

Para no contribuir más a esta confusión, en lugar de tratar de exponer algunos de sus enunciados más utilizados prefiero centrarme en las diferentes perspectivas que sobresalen en la actualidad, caracterizándolas por medio de los siguientes dos enfoques principales:

También es posible encontrar un cierto consenso al clasificar los diferentes tipos de Inteligencia Artificial en su tipología más clásica que diferencia entre:

Inteligencia Artificial débil o especializada, que responde a un enfoque pragmático al diseñarse para para realizar una tarea específica o un conjunto de tareas determinadas.

Inteligencia Artificial fuerte, con enfoque cognitivo, que puede comprender y aprender cualquier tarea intelectual como un ser humano, algo que por ahora no se ha podido lograr.

Inteligencia Artificial; ciencia y tecnología

La Inteligencia Artificial surgió en sus orígenes como una disciplina científica del campo de la informática cuyo desarrollo ha ido derivando para convertirse en una ciencia aplicada y punto de encuentro de otras múltiples como la informática o automática, matemáticas, psicología, lingüística, neurociencias, etc.

Asimismo, es un concepto tecnológico que integra una amplia variedad de tecnologías y metodologías que se utilizan para crear sistemas inteligentes que puedan aprender y realizar tareas similares a las propias de la funciones cognitivas humanas, como el aprendizaje, la resolución de problemas y la toma de decisiones.

Entre ellas destacan algunas que en la actualidad constituyen los componentes claves de la Inteligencia Artificial: el Aprendizaje automático (Machine learning), que habilita que las máquinas aprendan sin haber sido programadas explícitamente, y el Profundo (Deep learning), por el que los sistemas, imitando el funcionamiento del cerebro humano, aprenden por si mismos, siendo capaces de razonar y obtener sus propias conclusiones, el Procesamiento del lenguaje natural (PLN), interacción entre máquinas y personas mediante el uso de lenguajes humanos, las Redes neuronales, que simulando el funcionamiento del cerebro humano procesan información para reconocer relaciones en un conjunto de datos, la Visión artificial (Computing vision ), sistemas automatizados que procesan, analizan e interpretan datos visuales (por ejemplo fotografías y vídeos) de igual forma que lo hacen las personas y la Computación cognitiva que combinando ciencias cognitivas y de la computación crea sistemas que entienden y aprenden del lenguaje natural, resolviendo problemas y tomando decisiones.

Entre ellas destacan algunas que en la actualidad constituyen los componentes claves de la Inteligencia Artificial: el Aprendizaje automático (Machine learning), que habilita que las máquinas aprendan sin haber sido programadas explícitamente, y el Profundo (Deep learning), por el que los sistemas, imitando el funcionamiento del cerebro humano, aprenden por si mismos, siendo capaces de razonar y obtener sus propias conclusiones, el Procesamiento del lenguaje natural (PLN), interacción entre máquinas y personas mediante el uso de lenguajes humanos, las Redes neuronales, que simulando el funcionamiento del cerebro humano procesan información para reconocer relaciones en un conjunto de datos, la Visión artificial (Computing vision ), sistemas automatizados que procesan, analizan e interpretan datos visuales (por ejemplo fotografías y vídeos) de igual forma que lo hacen las personas y la Computación cognitiva que combinando ciencias cognitivas y de la computación crea sistemas que entienden y aprenden del lenguaje natural, resolviendo problemas y tomando decisiones.

A la búsqueda del equilibrio entre ética e Inteligencia Artificial

La aplicación de las tecnologías inherentes al concepto de Inteligencia Artificial es causa de profundos cambios, con gran impacto en la sociedad, generando nuevas oportunidades de desarrollo económico y social, pero a su vez es origen de importantes desafíos éticos a los que debemos hacer frente, buscando el equilibrio adecuado entre ella y el factor humano.

Ya en 1942 Isaac Asimov trató este asunto al introducir en sus novelas de ciencia ficción sus famosas leyes de la robótica que combinaban cuestiones filosóficas y morales. La primera determinaba que: “Un robot no puede dañar a un ser humano ni por inacción permitir que un ser humano sufra daño” eEs decir, no sólo no debe causar daño, sino también debe evitarlo.

La segunda establecía que: “Un robot debe cumplir las órdenes de los seres humanos, excepto si dichas órdenes entran en conflicto con la Primera Ley” y finalmente, la tercera manifestaba que: “Un robot debe proteger su propia existencia en la medida en que ello no entre en conflicto con la Primera o la Segunda de las Leyes”.

Mas tarde Asimov propuso la que denominó Ley Cero, una generalización o mejora de la primera, donde se establece que «un robot no puede dañar a la humanidad ni permitir que sufra algún daño por inacción», es decir que ya no solo se refiere al “hombre” sino a la humanidad.

Sin embargo, en la actualidad estas leyes serían inadecuadas y no aplicables pues la robótica actual ya no se corresponde con la que imaginó Asimov. La Inteligencia Artificial es algo, bastante más, que robots, y como sus componentes y sistemas no son humanos no pueden responder a leyes; lo importante es aplicar códigos éticos a quienes desarrollan e implementan sus tecnologías y aplicaciones.

Entre las diferentes iniciativas que se están llevando a cabo en este sentido, como las de la UNESCO el año 2021, quiero destacar aquellas que en el marco de la Unión Europea se orientan a los agentes que ofrezcan sistemas de Inteligencia Artificial que impacten a personas ubicadas en la Unión con independencia de que dichos agentes estén establecidos o no dentro de sus fronteras.

En este contexto en los últimos años se han publicado diferentes documentos como por ejemplo las Directrices éticas para una Inteligencia Artificial de confianza (2019), el Libro Blanco sobre Inteligencia Artificial (2020) donde se propone un marco legislativo que impulse la confianza en ella respetando los derechos fundamentales y la ética, y sobre todo Ley de Inteligencia Artificial, de 2021, que representa una propuesta para regular los usos de la Inteligencia Artificial con el fin de abordar adecuadamente sus beneficios y riesgos.

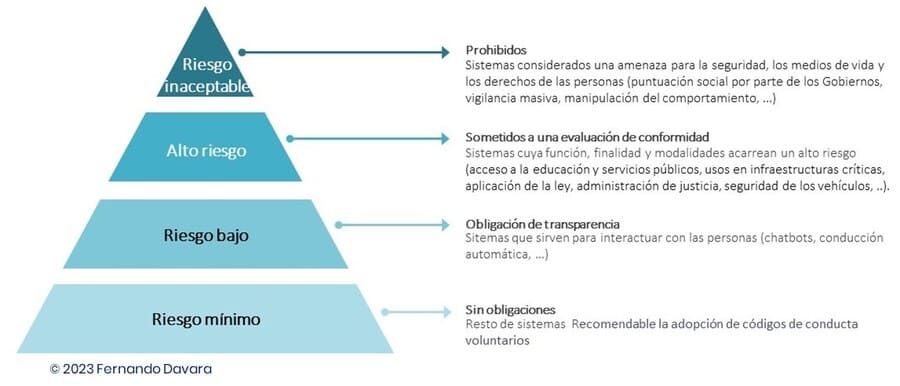

La propuesta, que no entrará en vigor hasta su aprobación por el Parlamento Europeo, adopta un enfoque basado en riesgos, describiendo cuatro niveles (riesgo inaceptable, alto riesgo, riesgo bajo y riesgo mínimo) con reglas diferentes a aplicar en cada nivel determinando las obligaciones y restricciones de uso que se aplicarán en cada caso.

Al igual que otras propuestas y reglamentos de la Unión Europea, como el Reglamento General de Protección de Datos (RGPD), el Reglamento de Servicios Digitales (DSA) y el de Mercados Digitales (DMA), la Ley será aplicable a todos los usos de la Inteligencia Artificial que afecten a los ciudadanos de la Unión, independientemente de la sede del proveedor de servicios o del lugar donde se desarrolle o ejecute el sistema, dentro o fuera de las fronteras de la Unión.

La Ley se basa en las recomendaciones de las mencionadas «Directrices Éticas para una Inteligencia Artificial» publicadas en 2019 por el Grupo de expertos de alto nivel. De acuerdo con ellas la fiabilidad de la Inteligencia Artificial se basa en tres componentes que deben satisfacerse en todo tiempo:

La Inteligencia Artificial debe ser lícita, respetando todas las leyes y reglamentos aplicables

La Inteligencia Artificial debe ser ética de modo que se garantice el respeto de los principios y valores éticos

La Inteligencia Artificial debe ser robusta, tanto desde una perspectiva técnica como teniendo en cuenta su entorno social dado que, aunque sus intenciones sean buenas, sus sistemas pueden provocar daños accidentales.

En conclusión:

Las oportunidades que presenta la Inteligencia Artificial son indudables, pero también conllevan riesgos a los que es preciso hacer frente de forma adecuada y proporcionada.

Es necesario que sea confiable, responda a principios éticos y se centre en las personas con el compromiso de utilizarla al servicio de la humanidad y del bien común.

Y este es precisamente el momento de hacerlo para evitar que mañana sea demasiado tarde.

Deja tu comentario